Tras la entrada en vigor el pasado mes de diciembre de ley australiana que prohíbe el acceso a las redes sociales para los menores de 16 años, son varios los países que ya avanzan para adoptarla, como Francia, Reino Unido, España o la Unión Europea, aunque cada uno con sus propias propuestas.

Los menores de edad pasan de media en las redes sociales más de una hora al día, siendo los españoles los que más tiempo dedican, con una media de 1 hora y 17 minutos concretamente, según un reciente informe de Qustodio.

TikTok sigue siendo la red social preferida por los menores de edad, que invierten en ella una media de 2 horas y 12 minutos diarios. El motivo del éxito de TikTok no es otro que su ‘feed’ de vídeos verticales de corta duración, diseñado para enganchar a los usuarios con contenido de su interés.

Precisamente, cada vez son más las redes y plataformas que buscar imitar el modelo de vídeos verticales de corta duración de TikTok. Sin embargo, el consumo de este tipo de formatos pueden provocar efectos en los menores, como sobreestimulación, exceso de dopamina, atención fragmentada o alteración del sueño, según ha indicado Qustodio.

Unicef también ha mostrado su preocupación por el acceso temprano de los menores a las redes sociales, y es que el 78,3% de los niños de los últimos cursos de Primaria (10 y 11 años) ya tiene presencia en alguna red.

La organización alerta de que un 6% de los adolescentes podría presentar un patrón de uso problemático tras una «conexión excesiva y poco controlada», lo que desemboca en una necesidad constante de conectarse, dificultad para reducir el tiempo en línea y la presencia de «síntomas emocionales negativos» cuando no se accede a las redes.

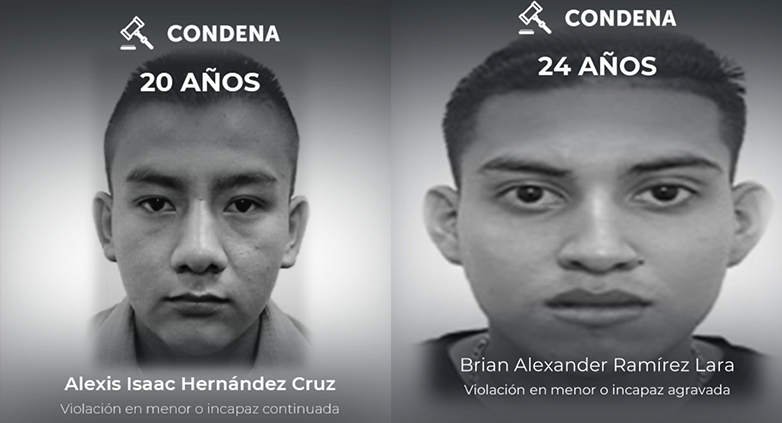

Otro de los problemas de los que advierte Unicef es el ‘sexting’ o contacto con desconocidos a través de redes sociales, que pueden derivar en riesgos vinculados al consentimiento, manipulación, exposición a riesgos sexuales o conductas delictivas. En esta línea, el 5,7% de los menores de 16 años ha indicado que han recibido alguna proposición sexual por parte de un adulto en Internet.

Ante esta serie de riesgos, el 46% de los padres considera que la edad mínima para acceder a las redes sociales debería aumentar a los 16 años, según Qustodio. Precisamente es la edad que tomó de referencia el Gobierno australiano a la hora de prohibir el acceso a las redes sociales a menores el pasado mes de diciembre.

Normativa por países

Australia se convirtió en diciembre en el primer país del mundo en prohibir el uso de redes sociales a los menores de 16 años tras entrar en vigor la ley propuesta por el primer ministro Anthony Albanese para mejorar el bienestar psicológico y social de los menores de edad.

Esta prohibición afecta al menos a diez plataformas de redes sociales y de ‘streaming’, entre las que se encuentran Facebook, Instagram, Threads, YouTube, TikTok, Snapchat, X, Reddit, Twitch y Kick, que deberán tomar «medidas razonables» para evitar que los menores de 16 años tengan una cuenta activa.

En el caso de no cumplir con la normativa, estas empresas podrían enfrentarse a multas de hasta 50 millones de dólares australianos (más de 29 millones de euros). Para evitar estas sanciones, Meta ya ha eliminado casi 550.000 cuentas en Instagram, Facebook y Threads.

Con esta regulación, Australia pone el foco en las empresas como responsables de que se cumpla la edad mínima de 16 años.

La Asamblea Nacional francesa ha dado luz verde este lunes la prohibición del acceso a las redes sociales a los menores de 15 años. Concretamente, se ha votado un proyecto de ley que contempla la prohibición del acceso a las redes sociales a los menores de 15 años y de la promoción de productos o servicios que puedan perjudicar su salud física o mental en redes sociales diseñadas para ellos.

No obstante, esta medida aún debe debatirse en el Senado francés a mediados del próximo mes de febrero. Si finalmente se aprueba allí, podría entrar en vigor desde septiembre, convirtiéndose en el primer país europeo en adaptar esta medida.

El panorama francés es muy similar al de Reino Unido, que el pasado 21 de enero votó a favor en la Cámara de los Lores la prohibición de las redes sociales para los menores de 16 años a través de la enmienda al Proyecto de Ley de Bienestar Infantil y Escuelas.

La propuesta británica aún debe debatirse en la Cámara de los Comunes, y en el caso de salir adelante, se tramitará a la espera de su entrada en vigor.

Además, Reino Unido ya implementó en julio sistemas de verificación de edad a los proveedores de servicios y plataformas en Internet en el marco de la Ley de Seguridad en Línea, con el fin de restringir el acceso a contenido pornográfico.

En el caso de España, el pasado mes de septiembre el Congreso dio luz verde a la ley orgánica para la protección de los menores en entornos digitales, que contempla el aumento de la edad mínima de registro en redes sociales a los 16 años (actualmente está en 14 años), así como obligar a los fabricantes de terminales de acceso a Internet a establecer medidas gratuitas de protección a los menores, como un sistema de control parental.

En esta línea, el Gobierno de Dinamarca anunció en noviembre un acuerdo para implementar una edad mínima de 15 años para el uso de las redes sociales, aunque se especificó qué plataformas se verían afectadas. Sin embargo, la normativa contempla que los padres autoricen su uso para los mayores de 13 años.

La regulación danesa busca que con esta restricción los niños «tengan más tiempo para jugar y desarrollarse antes de tener perfiles en redes sociales». El Ministerio de Digitalización ha señalado los efectos que pueden causar en los menores: «Sufren alteraciones del sueño, pérdida de concentración, y experimentan una presión creciente debido a las relaciones digitales en las que los adultos no siempre están presentes».

Además, el pasado mes de noviembre, el Parlamento Europeo propuso restringir el acceso a las redes sociales a los mayores de 16 años, aunque permitiendo su uso para los mayores de 13 años con el consentimiento de sus padres.

Los eurodiputados señalan la falta de implicación de las grandes plataformas a la hora de tomar medidas «adecuadas» para proteger a los menores. Por ello, también instan a una aplicación rápida y eficaz de la Ley de Servicios Digitales y a prohibir prácticas nocivas, como los diseños adictivos. En caso de incumplirse estas medidas, los eurodiputados apelan a exigir responsabilidades personales a los altos cargos de las empresas.

Paralelamente, la Comisión Europea tiene en marcha un proyecto piloto con varios países, entre ellos España, para contar con una plataforma capaz de verificar la edad real del usuario que accede a las redes.

Política de las redes sociales

Instagram establece que la edad mínima para la creación de una cuenta es de 14 años, y lanzó en noviembre de 2024 las ‘Cuentas para adolescentes’, con funciones de protección integradas más avanzadas por defecto, que limitan cuestiones como quién puede ponerse en contacto con ellos y el contenido que ven en la plataforma.

Estas cuentas también están presentes en Facebook, en el que la edad de registro en todo el mundo es de 13 años, salvo en España, Corea del Sur y Quebec (Canadá), donde asciende a los 14 años.

TikTok permite crear una cuenta a los usuarios mayores de 13 años, aunque matiza que es necesario que un usuario tenga más de 16 años para que sus vídeos se muestren en el feed ‘Para ti’ o para usar los mensajes. Además, usan ajustes de privacidad más restrictivos y filtran cualquier contenido inapropiado.

X (antes Twitter) también establece en 13 años la edad mínima para usar la plataforma y avisa que expulsará a cualquiera que no cumpla este requisito. Las cuentas de menores son privadas por defecto, pudiendo aceptar o rechazar seguidores o mensajes privados.