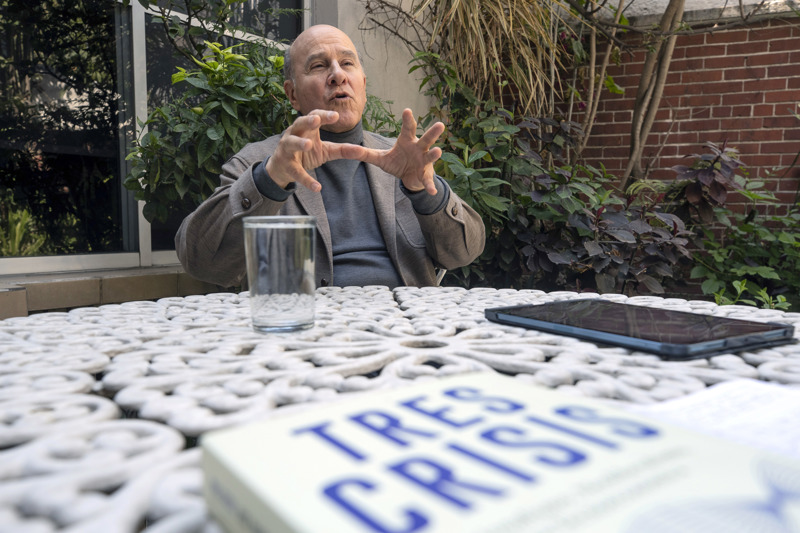

Juan Carlos Jiménez dirige la empresa IAKimi, una pionera en la enseñanza de la Inteligencia Artificial en El Salvador. La empresa entrena a personal de otras compañías en el conocimiento y entrenamiento de herramientas de Inteligencia Artificial.

En una conversación sobre los alcances de la Inteligencia Artificial, Jiménez, un ingeniero colombiano con 17 años de residir en El Salvador, explica que su metodología parte de enseñar que la IA no es exclusiva de ingenieros, sino una herramienta accesible para cualquier persona interesada en aprender y mejorar su rendimiento laboral.

¿Qué hace una empresa como IAKimi? Cómo enseñan a las demás empresas a usar la Inteligencia Artificial?

AIKimi fue creada para enseñarle a personal de otras compañías a utilizar la Inteligencia Artificial para integrarla en su recurso humano y que su recurso humano entienda qué es para mejorar su rendimiento. La Inteligencia Artificial es para nosotros una herramienta que tienen todas las personas para crecer, para mejorar, para aprender, y en la medida que eso lo apliquen en sus trabajos, van a poder ser personas de mucho más valor para las compañías y también en su vida personal. Les enseñamos que no es un tema de ingenieros sino que es un tema de querer aprender y lo hacemos con la práctica, básicamente les enseñamos a las personas a usar herramientas de inteligencia artificial para mejorar sus tareas diarias y lógicamente, la inteligencia artificial es algo que está hecha para que uno interactúe con palabras y textos naturales, como que le hablara a otra persona. En la medida que yo quiera aprender, él me enseña y en la medida que yo quiera automatizar o generar asistentes que me ayuden, él lo hace.

¿Y Cómo debería empezar una empresa interesada en adaptar sus procesos a la IA?

Nosotros creemos que una compañía debe empezar mirando sus procesos, donde gasta más tiempo su personal o su gente y cómo facilita esos procesos, para eso lo que tiene que tener claro es cuáles son esos procesos, eventualmente hay muchas compañías que no tienen claros esos procesos y eso es importante, lo que tú no mides bien, no lo vas a poder llevar a la inteligencia artificial porque lo que te permite es automatizar o mejorar lo que tú conoces, si no lo conoces, no lo puedes hacer, entonces normalmente lo que hacemos es encontrar con las compañías sus procesos estratégicos y ayudarlos a que su propia gente los automatice para un mejor resultado.

¿Con que debería empezar una persona con interés en aprender sobre la IA?

Una persona tiene que estudiar y practicar, hoy en temas de IA encuentran material en redes sociales, en expertos, coach, y básicamente en su mayoría son personas que tratan de transferir ese conocimiento de una manera muy natural, todos los fabricantes y creadores de plataformas de inteligencia artificial arrancan con herramientas sin costo, tienen tutoriales, modelos como GPT, tú le hablas y ellos entienden lo que dicen. Si una persona quiere aprender, es practicando.

¿La IA es para jóvenes o también para los mayores?

La IA para mí es más para mayores que para jóvenes, porque la IA es un mundo en el que si no sé para dónde voy, no me ayuda, la IA es como tener empleados, algo que hace lo que yo le diga que quiero hacer, entonces normalmente las personas que tienen experiencia son las personas que saben lo que quieren. Los jóvenes tienen la ventaja de que este mundo digital lo absorben más rápido pero pues la IA es tanto para jugar ni que me ayude a hacer cartitas, sino más que más que todo, para que me ayude a solucionar problemas y es ahí donde una persona mayor que se puede demorar un poco más en usar las herramientas pero creo que las va a usar mejor porque sabe lo que está buscando.

¿Uno de los mayores temores es la pérdida de empleos, cuál es tu experiencia al respecto?

En el tema de pérdida de empleos yo creo que es al revés, creo que la IA va a quitar empleos a personas que no entiendan la evolución que se está teniendo, un poco como cuando salió el computador que mucha gente creyó que tenían que seguir trabajando como ellos pensaban y sin usar computador, pero otra gente optó por esforzarse y usar el computador y lógicamente, eso te hace más eficiente. Creo que lo mismo va a pasar con la IA, la diferencia va a ser el tiempo, creo que el tema del computador se demoró años que la gente ya la adoptara y se volviera una herramienta de uso diario, pero la IA va a una velocidad increíble y mucho más lo va a aprovechar. Creo que va a reemplazar a las personas que no entiendan que aprender a usar la IA es algo necesario, no es algo accesorio o que no deba tener claro, las personas que lo tengan claro y lo vuelvan una herramienta clave de lo que ellos hacen, y la sepan usar, seguramente no serán reemplazadas. Creo que se van a generar trabajos a nivel superior, a nivel más sofisticado, porque lógicamente se demorará mucho menos y me quedará tiempo para hacer cosas más de pensamiento, de temas humanos, curiosamente creemos que la IA lleva a las personas a cosas más humanas que es interactuar con otras personas, a varios temas, que a lo que se dedican hoy como generar informes, generar control, a cosas que realmente los robots pueden ser más eficientes haciendo eso y a las personas les tocará temas más estratégicos y de relacionamiento personal, entonces creo que la IA llevará a la persona se concentre más en ser humano y eso los va a llevar a otro nivel de desarrollo.

Lo que puedo hacer yo, lo puedo hacer un robot. ¿Entonces debería preocuparme o cómo debo prepararme ante esa nueva realidad?

Yo creo que si lo que yo hago lo puede hacer un robot, pues sí tengo que preocuparme, lo que tengo que pensar es que si lo que yo hago lo puede hacer un robot, yo debería entrenar ese robot para que hiciera lo que yo hago y debería ponerme a pensar que con ese potencia de tiempo y de cabeza que me quede, qué hago que no pueda hacer un robot. Es la gran reinvención de las personas y las compañías, es por eso que la empresa se llama Kimi, Kimi es una definición maya del Ave Fénix, que yo tengo que morir para renacer, y eso es lo que va a pasar con muchas personas, todo lo que hoy saben, van a tener que entender que si su mayor tiempo lo gastan en temas mecánicos, van a evolucionar eso a crear robots que hagan eso mecánico y ellos subir de nivel y hacer cosas más sofisticadas.

Algunos críticos de la IA advierten que te vuelve menos pensante, qué dices al respecto?

Desafortunadamente la IA es como cualquier cosa, como el internet o como muchas cosas que no es malo de por sí sino como yo lo uso. El internet lo puedo utilizar para conocer o aprender cosas, para hacer cosas buenas, como también puedo usarla para malgastar el tiempo, lo mismo la IA, si la uso bien es porque la uso para aprender y saber más, para que sea mi coach y en hacerme las cosas. Desafortunadamente gran parte de la población va a caer en usarla para que me haga las cosas y lógicamente mi riesgo es que voy a saber menos o voy a ser más bruto, pero el problema no está en la IA sino cómo yo la uso, como muchas cosas en la vida, si la uso mal, el resultado es malo, si la uso bien, el resultado es bueno. Ese es el punto, el que se quiera volver más bruto, se va a volver más bruto y va a tener menos conocimiento, el que quiera aprender más, lo va a hacer, será un tema de la decisión que yo tome.

¿Cuáles son los errores más comunes en el uso de IA?

El mayor error en el uso de la IA es la gobernabilidad, eso quiere decir que yo tengo que entender que la IA está para que haga lo que yo quiero que haga, no yo hacer lo que la IA me dice, en la medida que yo entienda eso, creo que siempre lo voy a saber usar y creo que es muy poco probable que yo cometa errores usando la IA, en la medida que yo pierda esa perspectiva y yo piense lo que la IA me dice, creo que voy a cometer un error fuerte puesto que eventualmente no estoy aprendiendo, sino haciendo lo que él me dice, básicamente es el mayor error que puede cometer la gente. La gente tiene que entender que es el jefe y no la IA pero es un tema de gobernabilidad y de entender lo que uno está haciendo.

Un estudio reciente de la Universidad de Zúrich advertía de la capacidad de la inteligencia artificial (IA) para manipular a la opinión pública con información falsa. Deberíamos tener ese temor en la sociedad?

El problema de la manipulación consideraría yo que es real, eso es desde hace mucho tiempo, hoy se hace mucho más masivo, inicialmente era manipular la opinión pública con medios de comunicación, después a través del internet en temas de poner o quitar mandatarios, y con la IA lógicamente ese peligro es mayor, pero al final, es un tema que cada persona tiene que tener un criterio para decidir qué es lo bueno, qué es lo malo, qué es lo cierto, qué no, a qué le debo poner atención y a qué no. El riesgo siempre ha existido en la medida que el internet popularizó mucho las comunicaciones y las acentuó más, y hoy con la IA viene un gran tema de desinformación o polución de la información pero creo que al final el punto es de criterio, creo que esto también va a llevar a un punto donde ya afortunadamente mucho fake news se va a desprestigiar porque va a ser tanta la avalancha que creo que llegará un momento en que pierde mucha credibilidad y creo que el criterio de las personas de a qué le creo y a qué no le creo. La mayoría de personas buscarán otras alternativas informativas porque es un riesgo muy importante con la IA al menos por un tiempo.

¿Qué veremos en el futuro cercano en temas de Inteligencia Artificial?

Creo que viene el tema humanoide, es un tema que lo vamos a ver muy pronto, un año o menos, donde esa parte robótica humanoide va a empezar cosas muy interesantes y vamos a empezar a ver agentes de IA, robots que tú mismo vas a construir y que te van a funcionar casi que todo hablado, diciendo que haga esto o lo otro, y creo que va a funcionar muy bien, de manera que una persona sin mucho conocimiento podrá tener muchos asistentes digitales, un tema que ya se ve pero que le falta. Creo que a futuro habrá muchas herramientas que te permitirán hacer eso por la voz, seguramente vendrá todo el tema en los teléfonos porque la IA se irá a los teléfonos, donde una persona en un teléfono tengo un asistente que le haga todo lo que necesita y lo haga bien y entienda lo que está haciendo.

Automóviles autónomos también se desarrollarán, pero los expertos dicen que no es solo una cuestión de automóviles sin chofer, sino que dentro de todo el tema humano, se va a volver como un amigo mío, mi carro va a saber donde fui, qué hice, y se crearán relaciones como hoy hay personas que tienen con GPT o varios modelos, entonces será con mi carro sabrá cosas de las que yo hago. Mucha gente se sentirá acompañada porque tendrá amigos virtuales adultos, porque podrá hablar con ellos todos los días, debido a los problemas de soledad y depresión. Son cosas que se van a ver. ¿Qué impacto tenga? Será un tema muy difícil de controlar o reglamentar porque va muy rápido porque no hay forma que las leyes no van a ese ritmo y mucha gente no lo está viendo venir.